Melissa Macedo

A tecnologia e a ciência hegemônicas são há muito utilizadas como instrumentos de opressão pela classe burguesa. Hoje, a eugenia do século 19 é substituída pelo racismo algorítmico que atinge a parcela mais vulnerável da população de inúmeras maneiras.

São Paulo – Há muito se fala da importância da tecnologia e como suas aplicações podem facilitar a nossa vida. Dos ‘Jetsons’ à ‘De Volta para o Futuro’, as especulações sobre as possibilidades que o avanço tecnológico traria sempre estiveram presentes. O problema surge quando, sob o neoliberalismo, essas iniciativas são usadas para o interesse dos mais ricos, por exemplo, impedindo melhorias reais em políticas públicas.

Dado a opacidade das informações que temos sobre como funcionam os sistemas, é fácil que empresas se escondam por trás da falsa sensação de tecnicidade e imparcialidade que códigos e equações complexas carregam. Nada disso é coincidência, mas sim um projeto para que não saibamos como questionar o que nos é proposto.

Foi assim que a CUFA (Central Única das Favelas) usou cadastro de biometria facial para fazer doações de cestas básicas. A organização – que interrompeu o uso da tecnologia e se retratou – pôde ter tal abordagem graças à falta de conhecimento sobre as consequências que esse tipo de algoritmo pode ter.

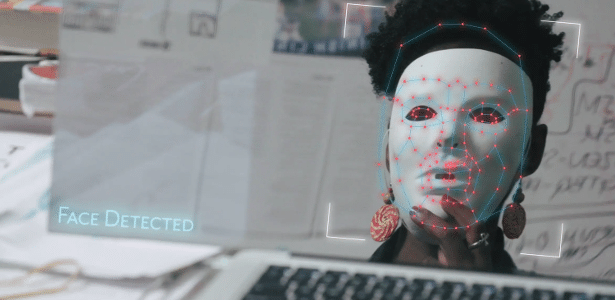

Reconhecimento Facial e a População Racializada

83% dos presos injustamente por reconhecimento fotográfico são negros. Este é um fato que, ainda que alarmante, não é inesperado dentro da sociedade racista em que vivemos. Já é sabido que quem mais sofre abaixo do capitalismo são os pobres, racializados, mulheres, dentre outras ”minorias” sociais. Estudos apontam vieses racistas de algoritmos de reconhecimento facial que tem 100 vezes mais chances de identificar erroneamente pessoas negras e asiáticas do que brancas.

Considerando que essa é uma das grandes apostas atuais para área de segurança, tudo aponta para o mesmo cenário de criminalização da negritude em que já estamos. É ainda pior se pensarmos no poder de coleta de dados e invasão de privacidade desses sistemas que já são usados em larga escala em aeroportos, shoppings, delegacias, etc. pelo mundo todo.

Lembremos ainda que a tecnologia de reconhecimento é relativamente recente e não há nenhuma lei que regulamente seu uso aqui no Brasil.

O perfil de um criminoso

Ainda no meio da segurança pública, nos Estados Unidos, o uso de um programa para auxiliar nos julgamentos foi questionado pelo viés apresentado. O algoritmo atribuía uma pontuação de 1 a 10 referente aos possíveis riscos de reincidência de uma pessoa (10 indicando um alto risco).

Os dados utilizados para previsão eram tais como gênero, idade, cor, crime acusado, entre outros. Em alguns estados esses dados foram passados para o júri para ajudar na escolha da sentença.

Em primeiro lugar, o poder de predição do modelo não era dos melhores: daqueles julgados como mais propensos a cometer outro delito somente 61% o fizeram. Mas o mais importante foi que pessoas negras eram quase duas vezes mais falsamente acusadas como possíveis criminosos enquanto brancos eram mais vezes categorizados erroneamente com baixo risco de reincidência.

Novamente foi reforçado o estigma racista sob o qual o povo preto é enxergado, contribuindo também para o encarceramento em massa dessa população.

Como um algoritmo criou incêndios e ajudou a especulação imobiliária

Os problemas com a tecnologia não são novidade. Foi nos anos 70 que o uso de um modelo computacional – criado para auxiliar a tomada de decisões no combate de incêndios – resultou na expulsão de comunidades negras, latinas e imigrantes de bairros inteiros.

O algoritmo foi treinado com dados históricos da região para poder alocar recurso de forma a otimizar custos, porém, o que aconteceu foi o seguinte: dado que bairros periféricos tendem a ser menos atendidos, poucos eram os dados coletados sobre eles. Assim, com a falta de informação, ainda menos recursos foram repassados para tais regiões.

Como se não bastasse, intencionalmente, algumas entradas de dados eram manipuladas para favorecer bairros ricos e pessoas influentes.

Mesmo depois de protestos contra a negligência do governo, novamente a pouca noção do funcionamento da tecnologia tornou difícil a autoridade técnica da empresa que criou a tal ‘solução’.

Tudo isso resultou em inúmeras casas em chamas. O que restou de alguns bairros foi ‘aproveitado’ em planos de mudanças da cidade, enquanto famílias perderam seus lares.

Por um uso crítico e saudável da tecnologia

Ainda assim são benéficos o uso da ciência e da tecnologia. É válido lembrar que um algoritmo racista só é racista porque foi programado dessa forma, inserido numa sociedade capitalista e neoliberal que se aproveita dos meios de produção para lucrar às custas do proletariado.

Se queremos uma mudança significativa é preciso pensar numa ciência que seja feita do povo para o povo, acessível e longe das mãos daqueles que só pensam no lucro.

Enquanto não chegamos lá, que estudemos para ter autonomia e questionar o uso dessas novas ferramentas e não sejamos paralisados pela falta de conhecimento. É preciso tirar da tecnologia seus ares de misticismo e trazer à luz as implicações do seu uso sem nos deixar enganar por aqueles que mascaram os horrores da exploração por trás de jargões técnicos e falsas ideias de desenvolvimento.

Que lutemos por um mundo bom, justo, onde as novas descobertas estejam sempre atreladas ao bem-estar da classe trabalhadora.

Falar da natureza da tecnologia é um assunto que parece nunca ter fim.

Me lembro de uma história parecida com essa, na Inglaterra: por causa da COVID, o equivalente do “ENEM” de lá ficou impossibilitado. A solução do governo foi escrever um algoritmo que dava uma pontuação pros alunos baseada nas notas anteriores dele, e a média daquela escola.

Resultado: alunos dedicados de bairros pobres tinham a nota rebaixada, enquanto nas escolas da elite todo mundo ficava no topo.

A situação foi resolvida depois, mas a lição é: esse tipo de tecnologia precisa estar sob controle da sociedade. Só o socialismo vai conseguir fazer isso.