Os avanços da Inteligência Artificial (IA) são inquestionáveis, mas, junto ao progresso, surge uma preocupação: a perpetuação de preconceitos históricos e desigualdades sistêmicas. A inteligência artificial tem um papel como ferramenta de avanço, mas também como um potencial instrumento de discriminação. Precisamos de alguns passos para criar um futuro tecnológico mais justo e inclusivo.

Reinilson Câmara | São Paulo

OPINIÃO – A IA está se tornando cada vez mais presente em nossas vidas, de decisões judiciais a avaliações de inquilinos e seleção de candidatos a empregos. Entretanto, a falta de diversidade na indústria tecnológica e a ausência de regulamentações claras podem intensificar o problema dos vieses discriminatórios presentes nessas ferramentas.

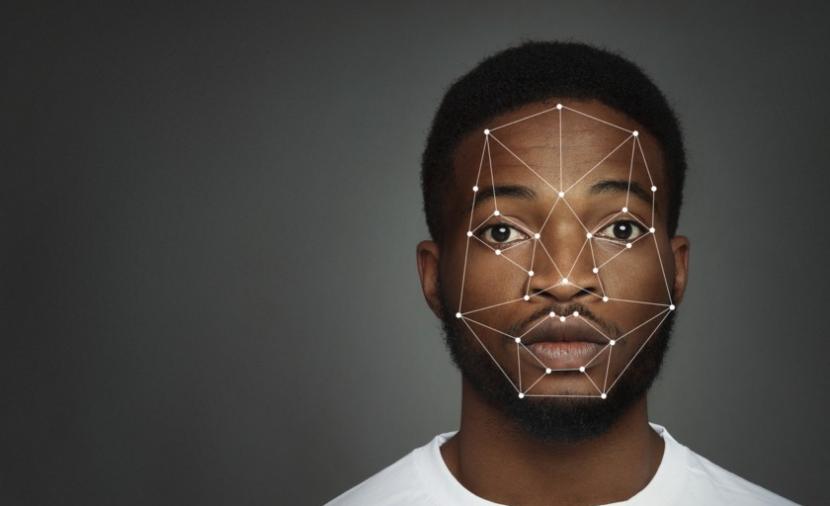

Os vieses encontrados nos sistemas de IA derivam, em grande parte, dos dados usados para treiná-los. Muitas vezes, esses dados não são representativos de todos os grupos da sociedade, especialmente aqueles que são historicamente marginalizados. Esta falta de representatividade nos dados e na indústria de tecnologia como um todo, pode levar a resultados discriminatórios.

Embora a Inteligência Artificial esteja sendo cada vez mais empregada no cotidiano, surge a indagação: quem detém o controle e assume a responsabilidade quando os algoritmos resultam em respostas que perpetuam racismo, machismo, sexismo ou outras formas de discriminação?

Um exemplo notável é o sistema jurídico, onde a IA está sendo cada vez mais usada. No entanto, quem garante que os algoritmos usados para determinar sentenças sejam justos e imparciais?

Essa questão ganhou destaque em 2016, quando a ProPublica publicou um relatório chamado “Machine Bias“, que investigou a presença de vieses discriminatórios nos algoritmos usados no sistema jurídico criminal dos EUA.

A discriminação também é evidente em processos automatizados para avaliar inquilinos em potencial. Esses sistemas, que dependem de registros judiciais e outros conjuntos de dados historicamente discriminatórios, podem acabar negando moradia a indivíduos capazes de pagar o aluguel, mas que são considerados “inelegíveis” pelos algoritmos de avaliação.

Quando falamos de contratação, um estudo feito pela Universidade de Stanford em 2022 mostrou que as ferramentas de IA utilizadas por empregadores para selecionar candidatos muitas vezes perpetuam vieses inconscientes. Esses algoritmos, por exemplo, podem ser influenciados por disparidades de gênero, raça e idade nos dados de treinamento. Como resultado, candidatos que são mulheres, negros e negras ou pessoas mais velhas podem ser injustamente excluídas do processo de seleção.

Da mesma forma, as práticas de concessão de empréstimos também não estão livres desses preconceitos. Um relatório de 2021 da National Community Reinvestment Coalition nos Estados Unidos revelou que algoritmos de empréstimos automatizados usados por bancos e outras instituições financeiras podem discriminar contra pessoas de cor e outros grupos marginalizados.

Segundo o relatório, pessoas negras solicitando empréstimos foram quase duas vezes mais propensas a terem seu pedido negado do que pessoas brancas, mesmo quando consideradas variáveis como renda, valor do empréstimo e localização do imóvel.

Lutar por um uso crítico e saudável da tecnologia

Pesquisadores e ativistas defendem a criação de padrões éticos e regulamentações mais rígidas no desenvolvimento e uso de IAs incluindo a transparência na coleta de dados, o uso de conjuntos de dados mais diversos e representativos, e a implementação de auditorias e testes contínuos para identificar e corrigir vieses.

A IA e outras tecnologias podem ser forças poderosas para o progresso, mas precisam ser usadas de maneira justa. Um algoritmo discriminatório não nasce preconceituoso, mas é moldado pelos vieses da sociedade em que foi criado. Em um mundo dominado por ideologias capitalistas, esses algoritmos podem ser usados para perpetuar a desigualdade.

Precisamos de uma ciência que seja do povo e para o povo – acessível a todos e não apenas a um grupo que busca lucro. Enquanto caminhamos para essa realidade, devemos questionar o uso dessas novas ferramentas desmistificando a tecnologia e expondo as consequências de seu uso.

O objetivo é uma sociedade justa, onde os avanços tecnológicos beneficiem a todos, e não apenas a um grupo de elite. Devemos usar a tecnologia para melhorar a vida de todos. Imagine uma sociedade onde a automação e a inteligência artificial liberam mais tempo para nos dedicarmos à arte, à cultura, à pesquisa e à ciência.

O verdadeiro sonho seria viver em um sistema onde a automação e a IA beneficiem a todos e todas, proporcionando mais tempo para atividades enriquecedoras. No entanto, para atingir esse ideal, precisamos construir essa sociedade, lutando todos os dias para criar um futuro melhor e mais justo para as próximas gerações.

Bom dia! nesse sentido, entende-se que, o gatilho para todos os problemas existentes no processo de IA, encontra-se nos seres humanos, estes por sua vez, são responsáveis pela programação dos algoritmos existentes nas IAs, atrasando todo o progresso de um processo perfeito, que é a IA.